gpt-54-mini-nano

GPT-5.4 mini와 nano: 더 싸고 더 빠르게 일한다

2026년 3월 17일 OpenAI는 GPT-5.4 mini와 GPT-5.4 nano를 공개했습니다. mini는 GPT-5.4의 코딩·툴 사용·컴퓨터 사용 성격을 유지하면서도 GPT-5 mini보다 2배 이상 빠른 소형 주력 모델로 포지셔닝됐고, nano는 분류·추출·랭킹·보조 코딩 에이전트에 맞춘 최저가 실행 모델로 분리됐습니다. 지금 시점에서 중요한 점은 mini가 API, Codex, ChatGPT까지 연결되면서 실제 사용자 접점에 들어왔고, nano는 API 전용으로 남아 멀티모델 에이전트 구조의 하단 실행 계층 역할을 맡게 됐다는 점입니다.

배경과 맥락

이번 발표는 단독 이벤트라기보다 GPT-5.4 라인업 확장의 두 번째 단계로 보는 편이 정확합니다. OpenAI는 2026년 3월 5일 먼저 GPT-5.4 Thinking과 GPT-5.4 Pro를 공개하며, 전문 작업용 상위 모델과 에이전트 기능, 컴퓨터 사용, 대형 컨텍스트를 전면에 내세웠습니다. 그로부터 12일 뒤 등장한 mini와 nano는 같은 계열의 능력을 더 작은 비용과 더 짧은 지연 시간으로 끌어내려, 실제 호출량이 많은 워크로드에 붙이기 쉽게 만든 버전입니다.

이 점이 중요합니다. OpenAI는 발표문에서 코딩 어시스턴트, 서브에이전트, UI 스크린샷 해석, 실시간 멀티모달 앱을 대표 사용처로 직접 적었습니다. 즉 이번 주제는 "작은 GPT가 또 나왔다"가 아니라, 상위 모델이 계획과 판단을 맡고 작은 모델이 실행을 맡는 계층형 에이전트 구조를 OpenAI가 제품 수준에서 명시했다는 데 있습니다.

얼마나 개선됐나

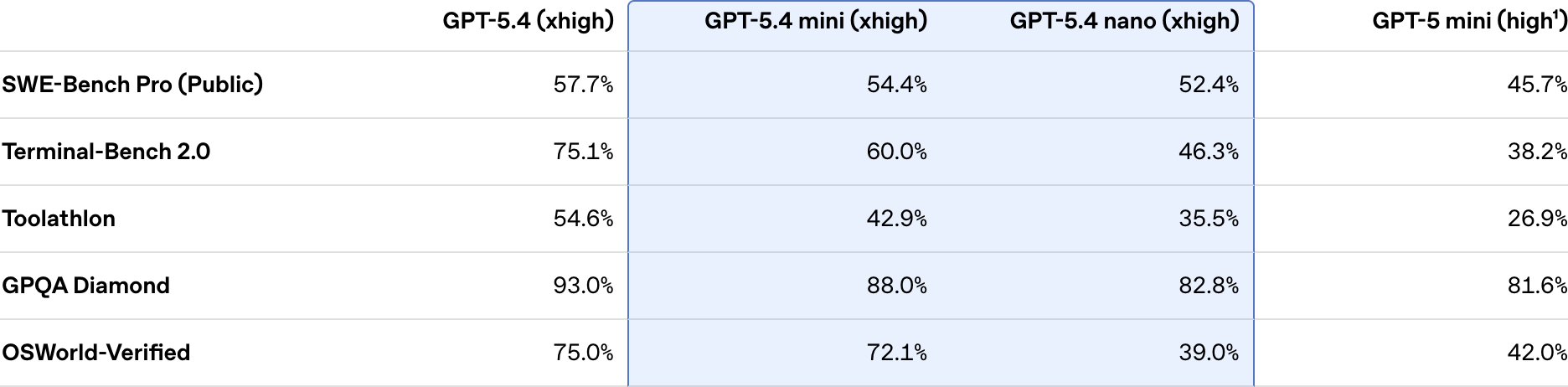

GPT-5.4 mini의 핵심은 단순한 경량화가 아니라 성능 대비 지연 시간의 재배치입니다. OpenAI는 mini가 GPT-5 mini보다 코딩, 추론, 멀티모달 이해, 툴 사용 전반에서 개선됐고 2배 이상 빠르다고 설명합니다. 이 문구가 과장이 아닌지는 공개 벤치마크 표를 보면 대략 방향이 맞습니다.

대표적으로 SWE-Bench Pro는 45.7%에서 54.4%로, Terminal-Bench 2.0은 38.2%에서 60.0%로, Toolathlon은 26.9%에서 42.9%로 올랐습니다. 가장 눈에 띄는 수치는 OSWorld-Verified입니다. GPT-5 mini의 42.0%에서 GPT-5.4 mini는 72.1%를 기록해, 컴퓨터 사용 계열에서 사실상 다른 급으로 올라섰습니다. nano는 그보다 낮은 절대 성능을 보이지만 SWE-Bench Pro 52.4%, Toolathlon 35.5%, GPQA Diamond 82.8% 수준이면 대량 분류·추출 업무에서는 충분히 매력적인 값입니다.

어디서 성능 차이가 나는가

mini의 강점은 "조금 똑똑한 저가 모델"이 아니라, 코딩과 툴 사용이 동시에 필요한 실무형 워크플로에 맞춰져 있다는 데 있습니다. 코드를 찾고, 고치고, 검색하고, 필요하면 컴퓨터를 조작하는 작업은 큰 모델의 정확도와 작은 모델의 속도를 모두 요구합니다. OpenAI가 이 모델을 coding assistants와 subagents에 맞춘다고 반복해서 설명한 이유도 여기에 있습니다.

발표문에서 든 예시는 Codex입니다. 더 큰 모델이 계획, 조정, 최종 판단을 맡고 GPT-5.4 mini 서브에이전트가 코드베이스 검색, 큰 파일 검토, 보조 문서 처리 같은 하위 작업을 병렬로 맡는 구조입니다. 이 설명은 곧 mini의 대표 사용처를 압축해서 보여줍니다. 사람과 직접 상호작용하는 응답 화면에서는 지연 시간이 중요하고, 그렇다고 단순 규칙 기반 모델만 쓰기엔 성능이 부족한 구간이 많은데, mini가 바로 그 구간을 겨냥합니다.

nano는 포지션이 더 분명합니다. OpenAI는 이 모델을 분류, 데이터 추출, 랭킹, 단순한 코딩 서브에이전트에 권장합니다. Engadget도 같은 지점을 짚었습니다. 즉 mini가 "작아졌지만 아직 주력으로 쓸 수 있는 모델"이라면, nano는 "큰 모델이 쪼갠 일을 싸게 많이 처리하는 실행 엔진"에 더 가깝습니다.

누가 지금 쓸 수 있나

출시 당시 기준으로 GPT-5.4 mini는 API, Codex, ChatGPT에 모두 들어왔습니다. API에서는 텍스트·이미지 입력, 툴 사용, 함수 호출, 웹 검색, 파일 검색, 컴퓨터 사용, 스킬을 지원하고 400k context window를 제공합니다. Codex에서는 앱, CLI, IDE extension, 웹 전반에서 사용할 수 있고, OpenAI는 mini가 GPT-5.4 쿼터의 30%만 쓰기 때문에 더 간단한 코딩 작업을 약 3분의 1 비용으로 처리할 수 있다고 설명합니다.

ChatGPT 쪽은 접근 방식이 조금 더 복합적입니다. 2026년 3월 17일 발표문은 Free와 Go 사용자가 + 메뉴의 Thinking 기능으로 mini를 쓸 수 있고, 나머지 유료 사용자는 GPT-5.4 Thinking 한도 초과 시 mini가 fallback으로 제공된다고 적었습니다. 하루 뒤인 2026년 3월 18일 Help Center 업데이트는 무료와 Plus/Go 사용자가 사용량 제한을 넘기면 mini version of the model로 전환된다고 설명합니다. 표현은 다르지만, 현재 운영 방향이 "상위 모델 한도 밖에서는 작은 GPT-5.4 계열로 내려간다"는 점은 일관됩니다.

한계점

가장 분명한 제약은 GPT-5.4 nano의 배포 범위입니다. nano는 API 전용입니다. ChatGPT나 Codex에서 직접 선택할 수 없고, 개발자가 직접 멀티모델 오케스트레이션을 설계해야 가치가 납니다. 그래서 일반 사용자에게 체감되는 변화는 대부분 mini 쪽에서 먼저 일어납니다.

mini 역시 완전히 자유로운 독립 모델로 풀린 것은 아닙니다. ChatGPT에서는 티어와 한도 정책에 따라 Thinking 진입용이거나 fallback 역할을 맡습니다. 즉 사용자가 항상 mini만 고정 선택하는 구조라기보다, 상위 모델 사용량과 서비스 경험을 부드럽게 이어주는 완충재에 가깝습니다. 이 점은 개발자용 API 모델과 소비자용 ChatGPT 모델이 아직 완전히 같은 방식으로 노출되지는 않는다는 뜻이기도 합니다.

가격 차이도 분명합니다. 2026년 3월 18일 기준 OpenAI API 가격 페이지는 GPT-5.4를 입력 100만 토큰당 2.50달러, 출력 15.00달러로, GPT-5.4 mini를 0.75달러와 4.50달러로 제시합니다. 여기에 발표문 기준 nano는 0.20달러와 1.25달러입니다. 그러나 실제 시스템 비용은 토큰 단가만으로 끝나지 않습니다. 어떤 작업을 큰 모델에 남기고 어떤 작업을 작은 모델에 위임할지 설계하지 못하면, 이 가격표만으로는 기대한 절감 효과를 얻기 어렵습니다.

왜 중요한가

이번 공개가 중요한 이유는 OpenAI가 모델 성능을 "가장 큰 모델 하나"로만 경쟁하지 않겠다는 것읗 암시하기 때문입니다. 2026년 3월 5일 GPT-5.4 공개가 상위 추론 모델의 기준을 세웠다면, 2026년 3월 17일 mini와 nano 공개는 그 밑에서 실제 호출량과 비용을 감당할 실행 계층을 채운 사건입니다. 작은 모델의 의미가 보조재에서 인프라 핵심 부품으로 이동한 셈입니다.

현재 시점에서 이 변화는 두 갈래로 읽힙니다. 첫째, ChatGPT와 Codex에서는 mini를 통해 더 넓은 사용자 층에 GPT-5.4 계열 경험을 내려보내면서 서비스 속도와 한도 정책을 함께 관리하려는 운영 전략이 보입니다. 둘째, API에서는 GPT-5.4, mini, nano의 가격 차가 매우 분명해져, 앞으로는 모델의 절대 지능만큼이나 워크플로를 얼마나 잘 분해하느냐가 비용 경쟁력의 핵심이 될 가능성이 큽니다. Engadget이 Free·Go 사용자 배포를 제목으로 뽑은 것도, 이 출시가 개발자용 기술 업데이트를 넘어 제품 전략 변화로 읽히기 때문입니다.